Système RAG (Retrieval-Augmented Generation)

Permettre au LLM d'interroger la base de connaissance interne de votre entreprise

Vous voulez un assistant IA capable de répondre précisément à des questions sur vos produits, vos procédures, vos documents internes ? Un LLM standard ne peut pas le faire seul : il ne connaît pas vos données et risque d'inventer des réponses fausses.

Le Retrieval-Augmented Generation (RAG) résout ce problème. C'est une architecture qui permet au LLM de rechercher les informations pertinentes dans votre base de connaissance interne avant de formuler une réponse — exactement comme un expert qui consulte ses dossiers avant de vous répondre.

Résultat : des réponses précises, traçables et ancrées dans vos données réelles, quel que soit le volume de documents à interroger.

Notre mission : concevoir et déployer votre architecture RAG sur mesure, adaptée à vos sources de données, vos cas d'usage et vos exigences de sécurité.

"Un LLM qui improvise des réponses est inutile en entreprise. Un LLM qui consulte vos documents avant de répondre devient votre meilleur expert interne."

Pourquoi un système RAG plutôt qu'un LLM générique ?

Un LLM entraîné sur des données publiques ne connaît pas votre entreprise. Il ne peut pas répondre à des questions sur vos produits, vos procédures internes ou vos clients. Et s'il essaie, il risque d'halluciner des réponses plausibles mais fausses.

Le RAG résout ce problème fondamental en donnant au LLM accès à vos données réelles, à jour et vérifiées avant de générer une réponse.

Un système RAG permet notamment de :

- répondre avec précision aux questions sur vos produits, services et procédures

- éliminer les hallucinations en ancrant les réponses dans des sources vérifiables

- citer les sources utilisées pour chaque réponse, renforçant la confiance

- exploiter des documents non accessibles en ligne : manuels internes, contrats, fiches produit

- mettre à jour la base de connaissance sans réentraîner le modèle

- contrôler finement les accès par périmètre, rôle ou département

Le RAG, c'est la différence entre un assistant qui improvise et un assistant qui sait vraiment.

Qdrant

Notre méthode pour construire votre système RAG

Une architecture RAG performante repose sur la qualité de chaque étape, de l'ingestion des documents jusqu'à la génération de la réponse finale. Voici comment nous procédons.

Collecte, audit et préparation des sources documentaires

La qualité d'un système RAG dépend directement de la qualité des documents ingestes. Nous commençons toujours par un audit rigoureux de vos sources.

- Inventaire des sources : documentation interne, wikis, bases de connaissance, manuels, contrats, fiches produit, emails

- Audit de qualité : détection des doublons, des informations obsolètes ou contradictoires, des documents mal structurés

- Nettoyage et normalisation : standardisation des formats, suppression des éléments parasites (en-têtes, pièds de page, filigranes)

- Stratégie de mise à jour : définition du processus d'ajout et de mise à jour des documents dans la base

Des documents bien préparés sont le fondement d'un RAG qui répond avec précision et sans hallucination.

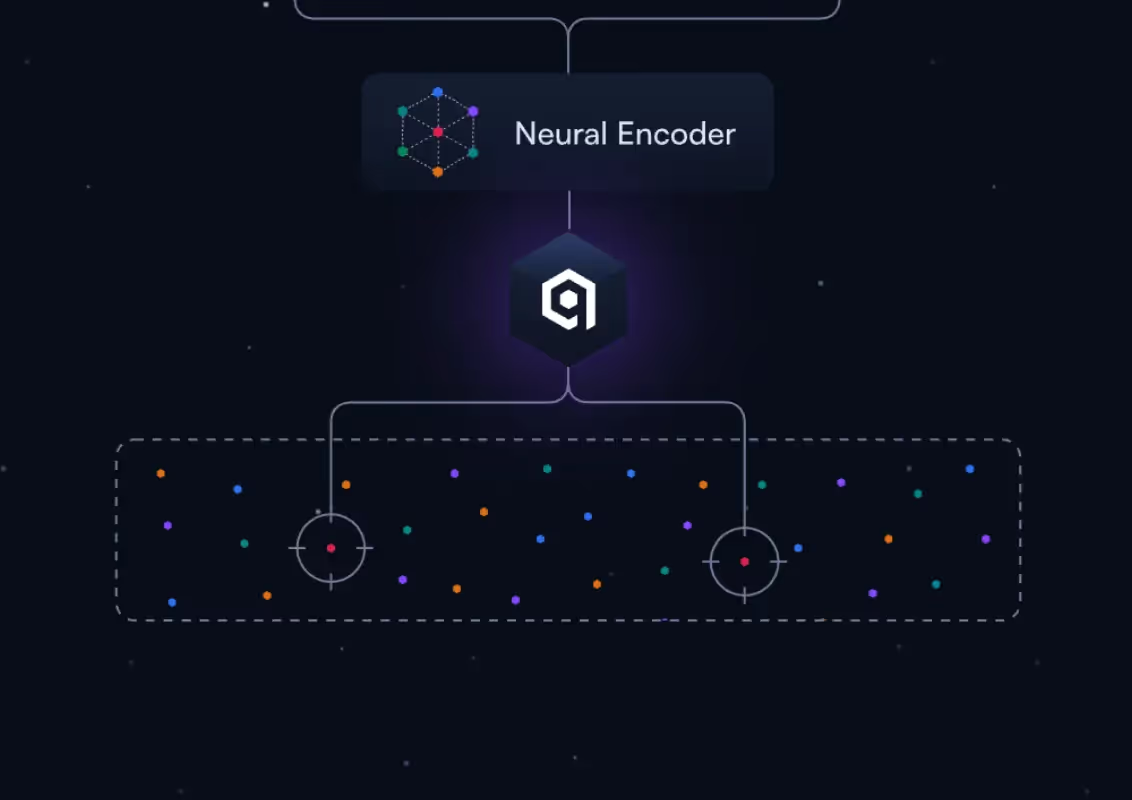

Chunking, embedding et indexation vectorielle

C'est le cœur technique du RAG. Chaque document est transformé en représentations mathématiques (vecteurs) qui capturent son sens, permettant au système de retrouver les passages les plus pertinents pour chaque question.

- Stratégie de chunking : découpage par taille fixe, par paragraphe, par section logique ou par structure sémantique selon le type de document

- Choix du modèle d'embedding : OpenAI text-embedding, Cohere, Mistral Embed ou modèles open-source selon les exigences de performance et de confidentialité

- Indexation dans une base vectorielle : Qdrant, Pinecone, Weaviate ou pgvector selon votre infrastructure

- Enrichissement métadonnées : ajout de métadonnées (source, date, auteur, département) pour filtrer les résultats selon le contexte

Une stratégie de chunking inadaptée est la première cause de mauvaises réponses dans un RAG. Nous testons plusieurs approches pour trouver la plus performante sur vos documents.

Pipeline de recherche et de récupération (Retrieval)

La phase de retrieval détermine quels passages de votre base de connaissance seront transmis au LLM pour générer la réponse. Sa qualité est déterminante pour la pertinence des réponses finales.

- Recherche sémantique : identification des passages les plus proches de la question en termes de sens, même si les mots exacts ne correspondent pas

- Recherche lexicale (BM25) : complémentaire de la recherche sémantique pour les termes techniques, acronymes et noms propres

- Recherche hybride : combinaison des deux approches pour maximiser la rappel et la précision

- Re-ranking : reclassément des résultats par un modèle de cross-encoder pour ne garder que les passages réellement pertinents

- Filtrage par métadonnées : restriction de la recherche à certaines sources, dates ou départements selon le profil de l'utilisateur

Un bon pipeline de retrieval est aussi important que le LLM lui-même : une mauvaise récupération produit de mauvaises réponses, quel que soit le modèle utilisé.

Génération augmentée et citation des sources

La phase de génération transforme les passages récupérés en une réponse lisible, précise et traçable.

- Prompt système RAG : instructions strictes pour que le LLM s'appuie exclusivement sur les passages fournis et ne les complète pas avec ses connaissances générales

- Citation systématique des sources : chaque affirmation est associée au document source, permettant à l'utilisateur de vérifier l'information

- Gestion de l'incertitude : quand la base ne contient pas la réponse, le LLM l'indique explicitement plutôt que d'improviser

- Formats de réponse adaptés : réponse courte, liste, tableau, ou résumé structuré selon le type de question et l'interface utilisateur

Une réponse traçable et citée est la clé de la confiance des utilisateurs dans un système RAG d'entreprise.

Évaluation, optimisation et maintenance du système RAG

Un système RAG déployé sans évaluation ni maintenance se dégrade rapidement à mesure que vos documents évoluent. Nous mettons en place les outils pour le maintenir au niveau.

- Cadre d'évaluation RAG : mesure de la fidélité (la réponse correspond-elle aux documents ?), de la pertinence (les bons passages sont-ils récupérés ?) et de la satisfaction utilisateur

- Détection des échecs : identification automatique des questions auxquelles le système répond mal pour cibler les améliorations

- Pipeline de mise à jour documentaire : ingestion automatique des nouveaux documents et mise à jour des chunks obsolètes

- Optimisation continue : ajustement du chunking, des paramètres de retrieval et des prompts selon les retours terrain

- Tableau de bord de monitoring : suivi du volume de requêtes, des coûts d'API et des indicateurs qualité en temps réel

Mirax peut assurer la maintenance et l'optimisation continue de votre système RAG pour garantir sa performance dans la durée.

Vous avez un projet ?

Déployer un site internet vitrine, un site E-commerce, une application web en adéquation avec votre image de marque.

une approche qui a fait ses preuves

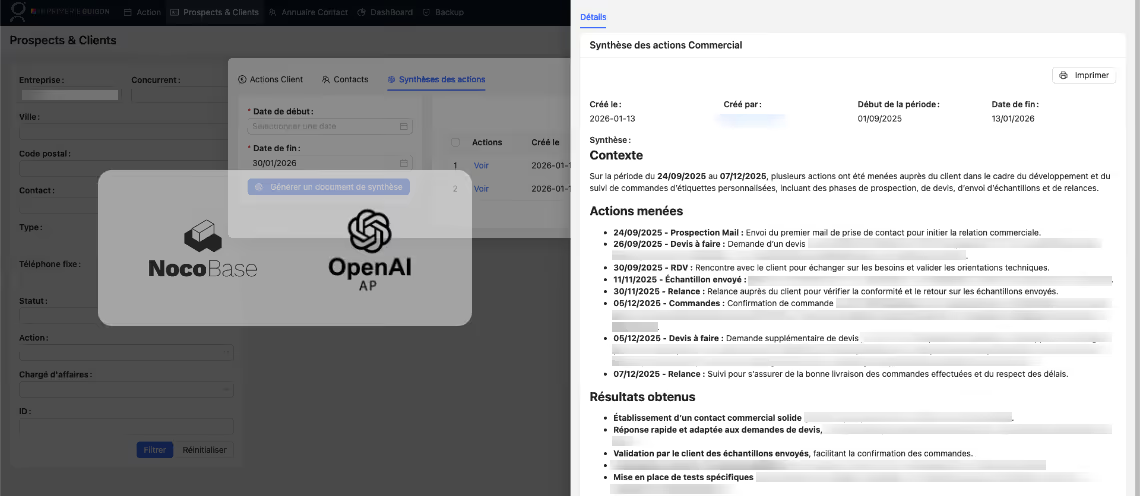

La société Atalus avait besoin d'un CRM. Le nouveau CRM a facilité les envoies, les relances jusqu'a la création des devis avec une excellente réactivité très bonne expérience.

Maxime a créé mon site internet il y a plus d’un an, et je n’ai absolument rien à redire ! L’accompagnement était top, les choix toujours justes, et la réalisation super rapide. Tout s’est fait dans la confiance, avec beaucoup de réactivité et de bon goût. Je recommande les yeux fermés !

Dans la conception et la réalisation de ce site web, Maxime a su choisir l'outil adapté, il a réussi l'intégration de données, images, et médias particulièrement variées et pas toujours adaptées à la publication web. Il a bien initié le référencement du site. Il nous a ensuite formé pour que nous puissions reprendre la main et faire évoluer ce site web et y rajouter des pages, des produits sans l'intervention d'aucun prestataire.

Je recommande à 100% de mener vos projets au côté de Mirax. Nous l’avons recruté pour développer le site de notre agence de communication et tout le suivi a été parfait. On a pu faire plusieurs réunions pour poser les bases, toutes nos attentes ont été comprises et mises en place. Et surtout, tout a pu se faire dans un timing très serré, Maxime est resté à l’écoute du début à la fin et s’est adapté à nos retours. On aurait pas pu attendre mieux ! Merci à Maxime pour sa patience et son abnégation, grâce à lui on a pu lancé notre agence dans les meilleures conditions !

Nous avons eu la chance de travailler avec Maxime sur le développement de notre site web ainsi que sur la création d'une plateforme de prospection entièrement conçue avec des outils no-code. Le résultat est au-delà de nos attentes : des solutions parfaitement compatibles, un UX agile iet sur-mesure, et surtout un budget totalement maîtrisé. Maxime a su nous accompagner étape par étape dans la réalisation de notre POC, avec une écoute constante et une réactivité exceptionnelle à chaque besoin d’ajustement ou de modification. Le déploiement auprès de nos clients s’est fait sans accroc, et les retours ont été unanimes : clairs, intuitifs, efficaces. Sa disponibilité, sa souplesse et la qualité de son travail font clairement la différence. Un partenaire de confiance que nous recommandons les yeux fermés.

J'ai pu travailler avec Maxime sur mon site internet et sur mon Logo ! Très professionnel et prend bien en compte les demandes du client !! Je recommande, merci à lui !!

Mirax allie une vraie expertise IA à une forte sensibilité business. Ils ont rapidement compris notre activité et nos enjeux. Restitution claire, structurée et accessible aux non-spécialistes. Sérieux, pédagogues, orientés résultats : collaboration que nous recommandons.

Maxime est une personne à l’écoute, compétente et réactive. Il va plus loin que ce qu’on lui demande et se démènera toujours pour ses clients. Un vrai plaisir de travailler avec lui.

J’ai fait appel à cette agence pour la création d’un CRM sur mesure et je suis vraiment très satisfait. L’équipe a parfaitement compris ma demande, les échanges ont toujours été fluides et constructifs. Le résultat est à la hauteur : le CRM fonctionne à merveille et correspond exactement à mes besoins. Top travail, je recommande vivement !

Un accompagnement au top ! Maxime nous a aidé à complètement automatiser la gestion de nos dashboards clients liés à nos campagnes de prospection. Notre reporting est désormais clair, visuel à la fois pour nos clients et pour nos équipes et surtout 100 % automatisé. Un vrai gain de temps et d'efficacité. Merci Maxime !

Maxime est quelqu'un de très sérieux et très pro. Il a su s'adapter à former des apprenants en formation pro, aussi bien en présentiel et distanciel, en faisant preuve d'une grande pédagogie et d'une belle expertise. Un vrai plaisir de travailler avec lui.

Nous avons fait appel à Maxime pour la refonte de notre site Webflow contact-nature ainsi que pour la connexion API avec notre centrale de réservation (via Make). Résultat : une collaboration fluide, efficace et de grande qualité ! Maxime a su être à l’écoute de nos besoins spécifiques en tant qu’agence de voyage. À partir d’une maquette initiale, nous avons construit ensemble chaque page du site, en affinant le design pas à pas avant validation. Il maîtrise parfaitement les subtilités de Webflow et a su développer un site à la fois clair, bien structuré et fidèle à notre univers. Mention spéciale pour la communication : simple, réactive, et toujours avec le souci du détail. Nous sommes pleinement satisfaits du résultat et recommandons Maxime sans hésitation pour tout projet Webflow ou intégration API !

Maxime a su répondre parfaitement à nos attentes dans le cadre de notre projet de site internet ! Vous pouvez le solliciter les yeux fermés

J’ai fait appel à cette agence pour la création d’un CRM sur mesure et je suis vraiment très satisfait. L’équipe a parfaitement compris ma demande, les échanges ont toujours été fluides et constructifs. Le résultat est à la hauteur : le CRM fonctionne à merveille et correspond exactement à mes besoins. Top travail, je recommande vivement !

J'ai pu travailler avec Maxime sur mon site internet et sur mon Logo ! Très professionnel et prend bien en compte les demandes du client !! Je recommande, merci à lui !!

Maxime est une personne à l’écoute, compétente et réactive. Il va plus loin que ce qu’on lui demande et se démènera toujours pour ses clients. Un vrai plaisir de travailler avec lui.

Mirax allie une vraie expertise IA à une forte sensibilité business. Ils ont rapidement compris notre activité et nos enjeux. Restitution claire, structurée et accessible aux non-spécialistes. Sérieux, pédagogues, orientés résultats : collaboration que nous recommandons.

Maxime a créé mon site internet il y a plus d’un an, et je n’ai absolument rien à redire ! L’accompagnement était top, les choix toujours justes, et la réalisation super rapide. Tout s’est fait dans la confiance, avec beaucoup de réactivité et de bon goût. Je recommande les yeux fermés !

Nous avons eu la chance de travailler avec Maxime sur le développement de notre site web ainsi que sur la création d'une plateforme de prospection entièrement conçue avec des outils no-code. Le résultat est au-delà de nos attentes : des solutions parfaitement compatibles, un UX agile iet sur-mesure, et surtout un budget totalement maîtrisé. Maxime a su nous accompagner étape par étape dans la réalisation de notre POC, avec une écoute constante et une réactivité exceptionnelle à chaque besoin d’ajustement ou de modification. Le déploiement auprès de nos clients s’est fait sans accroc, et les retours ont été unanimes : clairs, intuitifs, efficaces. Sa disponibilité, sa souplesse et la qualité de son travail font clairement la différence. Un partenaire de confiance que nous recommandons les yeux fermés.

La société Atalus avait besoin d'un CRM. Le nouveau CRM a facilité les envoies, les relances jusqu'a la création des devis avec une excellente réactivité très bonne expérience.

Je recommande à 100% de mener vos projets au côté de Mirax. Nous l’avons recruté pour développer le site de notre agence de communication et tout le suivi a été parfait. On a pu faire plusieurs réunions pour poser les bases, toutes nos attentes ont été comprises et mises en place. Et surtout, tout a pu se faire dans un timing très serré, Maxime est resté à l’écoute du début à la fin et s’est adapté à nos retours. On aurait pas pu attendre mieux ! Merci à Maxime pour sa patience et son abnégation, grâce à lui on a pu lancé notre agence dans les meilleures conditions !

Un accompagnement au top ! Maxime nous a aidé à complètement automatiser la gestion de nos dashboards clients liés à nos campagnes de prospection. Notre reporting est désormais clair, visuel à la fois pour nos clients et pour nos équipes et surtout 100 % automatisé. Un vrai gain de temps et d'efficacité. Merci Maxime !

Nous avons fait appel à Maxime pour la refonte de notre site Webflow contact-nature ainsi que pour la connexion API avec notre centrale de réservation (via Make). Résultat : une collaboration fluide, efficace et de grande qualité ! Maxime a su être à l’écoute de nos besoins spécifiques en tant qu’agence de voyage. À partir d’une maquette initiale, nous avons construit ensemble chaque page du site, en affinant le design pas à pas avant validation. Il maîtrise parfaitement les subtilités de Webflow et a su développer un site à la fois clair, bien structuré et fidèle à notre univers. Mention spéciale pour la communication : simple, réactive, et toujours avec le souci du détail. Nous sommes pleinement satisfaits du résultat et recommandons Maxime sans hésitation pour tout projet Webflow ou intégration API !

Dans la conception et la réalisation de ce site web, Maxime a su choisir l'outil adapté, il a réussi l'intégration de données, images, et médias particulièrement variées et pas toujours adaptées à la publication web. Il a bien initié le référencement du site. Il nous a ensuite formé pour que nous puissions reprendre la main et faire évoluer ce site web et y rajouter des pages, des produits sans l'intervention d'aucun prestataire.

Maxime a su répondre parfaitement à nos attentes dans le cadre de notre projet de site internet ! Vous pouvez le solliciter les yeux fermés

Maxime est quelqu'un de très sérieux et très pro. Il a su s'adapter à former des apprenants en formation pro, aussi bien en présentiel et distanciel, en faisant preuve d'une grande pédagogie et d'une belle expertise. Un vrai plaisir de travailler avec lui.

Mirax allie une vraie expertise IA à une forte sensibilité business. Ils ont rapidement compris notre activité et nos enjeux. Restitution claire, structurée et accessible aux non-spécialistes. Sérieux, pédagogues, orientés résultats : collaboration que nous recommandons.

Maxime a créé mon site internet il y a plus d’un an, et je n’ai absolument rien à redire ! L’accompagnement était top, les choix toujours justes, et la réalisation super rapide. Tout s’est fait dans la confiance, avec beaucoup de réactivité et de bon goût. Je recommande les yeux fermés !

Nous avons eu la chance de travailler avec Maxime sur le développement de notre site web ainsi que sur la création d'une plateforme de prospection entièrement conçue avec des outils no-code. Le résultat est au-delà de nos attentes : des solutions parfaitement compatibles, un UX agile iet sur-mesure, et surtout un budget totalement maîtrisé. Maxime a su nous accompagner étape par étape dans la réalisation de notre POC, avec une écoute constante et une réactivité exceptionnelle à chaque besoin d’ajustement ou de modification. Le déploiement auprès de nos clients s’est fait sans accroc, et les retours ont été unanimes : clairs, intuitifs, efficaces. Sa disponibilité, sa souplesse et la qualité de son travail font clairement la différence. Un partenaire de confiance que nous recommandons les yeux fermés.

Mirax allie une vraie expertise IA à une forte sensibilité business. Ils ont rapidement compris notre activité et nos enjeux. Restitution claire, structurée et accessible aux non-spécialistes. Sérieux, pédagogues, orientés résultats : collaboration que nous recommandons.

Maxime est une personne à l’écoute, compétente et réactive. Il va plus loin que ce qu’on lui demande et se démènera toujours pour ses clients. Un vrai plaisir de travailler avec lui.

Maxime est quelqu'un de très sérieux et très pro. Il a su s'adapter à former des apprenants en formation pro, aussi bien en présentiel et distanciel, en faisant preuve d'une grande pédagogie et d'une belle expertise. Un vrai plaisir de travailler avec lui.

J'ai pu travailler avec Maxime sur mon site internet et sur mon Logo ! Très professionnel et prend bien en compte les demandes du client !! Je recommande, merci à lui !!

Maxime a su répondre parfaitement à nos attentes dans le cadre de notre projet de site internet ! Vous pouvez le solliciter les yeux fermés

La société Atalus avait besoin d'un CRM. Le nouveau CRM a facilité les envoies, les relances jusqu'a la création des devis avec une excellente réactivité très bonne expérience.

Nous avons fait appel à Maxime pour la refonte de notre site Webflow contact-nature ainsi que pour la connexion API avec notre centrale de réservation (via Make). Résultat : une collaboration fluide, efficace et de grande qualité ! Maxime a su être à l’écoute de nos besoins spécifiques en tant qu’agence de voyage. À partir d’une maquette initiale, nous avons construit ensemble chaque page du site, en affinant le design pas à pas avant validation. Il maîtrise parfaitement les subtilités de Webflow et a su développer un site à la fois clair, bien structuré et fidèle à notre univers. Mention spéciale pour la communication : simple, réactive, et toujours avec le souci du détail. Nous sommes pleinement satisfaits du résultat et recommandons Maxime sans hésitation pour tout projet Webflow ou intégration API !

Dans la conception et la réalisation de ce site web, Maxime a su choisir l'outil adapté, il a réussi l'intégration de données, images, et médias particulièrement variées et pas toujours adaptées à la publication web. Il a bien initié le référencement du site. Il nous a ensuite formé pour que nous puissions reprendre la main et faire évoluer ce site web et y rajouter des pages, des produits sans l'intervention d'aucun prestataire.

Un accompagnement au top ! Maxime nous a aidé à complètement automatiser la gestion de nos dashboards clients liés à nos campagnes de prospection. Notre reporting est désormais clair, visuel à la fois pour nos clients et pour nos équipes et surtout 100 % automatisé. Un vrai gain de temps et d'efficacité. Merci Maxime !

Je recommande à 100% de mener vos projets au côté de Mirax. Nous l’avons recruté pour développer le site de notre agence de communication et tout le suivi a été parfait. On a pu faire plusieurs réunions pour poser les bases, toutes nos attentes ont été comprises et mises en place. Et surtout, tout a pu se faire dans un timing très serré, Maxime est resté à l’écoute du début à la fin et s’est adapté à nos retours. On aurait pas pu attendre mieux ! Merci à Maxime pour sa patience et son abnégation, grâce à lui on a pu lancé notre agence dans les meilleures conditions !

J’ai fait appel à cette agence pour la création d’un CRM sur mesure et je suis vraiment très satisfait. L’équipe a parfaitement compris ma demande, les échanges ont toujours été fluides et constructifs. Le résultat est à la hauteur : le CRM fonctionne à merveille et correspond exactement à mes besoins. Top travail, je recommande vivement !

Nous avons eu la chance de travailler avec Maxime sur le développement de notre site web ainsi que sur la création d'une plateforme de prospection entièrement conçue avec des outils no-code. Le résultat est au-delà de nos attentes : des solutions parfaitement compatibles, un UX agile iet sur-mesure, et surtout un budget totalement maîtrisé. Maxime a su nous accompagner étape par étape dans la réalisation de notre POC, avec une écoute constante et une réactivité exceptionnelle à chaque besoin d’ajustement ou de modification. Le déploiement auprès de nos clients s’est fait sans accroc, et les retours ont été unanimes : clairs, intuitifs, efficaces. Sa disponibilité, sa souplesse et la qualité de son travail font clairement la différence. Un partenaire de confiance que nous recommandons les yeux fermés.

La société Atalus avait besoin d'un CRM. Le nouveau CRM a facilité les envoies, les relances jusqu'a la création des devis avec une excellente réactivité très bonne expérience.

Je recommande à 100% de mener vos projets au côté de Mirax. Nous l’avons recruté pour développer le site de notre agence de communication et tout le suivi a été parfait. On a pu faire plusieurs réunions pour poser les bases, toutes nos attentes ont été comprises et mises en place. Et surtout, tout a pu se faire dans un timing très serré, Maxime est resté à l’écoute du début à la fin et s’est adapté à nos retours. On aurait pas pu attendre mieux ! Merci à Maxime pour sa patience et son abnégation, grâce à lui on a pu lancé notre agence dans les meilleures conditions !

J’ai fait appel à cette agence pour la création d’un CRM sur mesure et je suis vraiment très satisfait. L’équipe a parfaitement compris ma demande, les échanges ont toujours été fluides et constructifs. Le résultat est à la hauteur : le CRM fonctionne à merveille et correspond exactement à mes besoins. Top travail, je recommande vivement !

Nous avons fait appel à Maxime pour la refonte de notre site Webflow contact-nature ainsi que pour la connexion API avec notre centrale de réservation (via Make). Résultat : une collaboration fluide, efficace et de grande qualité ! Maxime a su être à l’écoute de nos besoins spécifiques en tant qu’agence de voyage. À partir d’une maquette initiale, nous avons construit ensemble chaque page du site, en affinant le design pas à pas avant validation. Il maîtrise parfaitement les subtilités de Webflow et a su développer un site à la fois clair, bien structuré et fidèle à notre univers. Mention spéciale pour la communication : simple, réactive, et toujours avec le souci du détail. Nous sommes pleinement satisfaits du résultat et recommandons Maxime sans hésitation pour tout projet Webflow ou intégration API !

Un accompagnement au top ! Maxime nous a aidé à complètement automatiser la gestion de nos dashboards clients liés à nos campagnes de prospection. Notre reporting est désormais clair, visuel à la fois pour nos clients et pour nos équipes et surtout 100 % automatisé. Un vrai gain de temps et d'efficacité. Merci Maxime !

Maxime est une personne à l’écoute, compétente et réactive. Il va plus loin que ce qu’on lui demande et se démènera toujours pour ses clients. Un vrai plaisir de travailler avec lui.

Dans la conception et la réalisation de ce site web, Maxime a su choisir l'outil adapté, il a réussi l'intégration de données, images, et médias particulièrement variées et pas toujours adaptées à la publication web. Il a bien initié le référencement du site. Il nous a ensuite formé pour que nous puissions reprendre la main et faire évoluer ce site web et y rajouter des pages, des produits sans l'intervention d'aucun prestataire.

Maxime a créé mon site internet il y a plus d’un an, et je n’ai absolument rien à redire ! L’accompagnement était top, les choix toujours justes, et la réalisation super rapide. Tout s’est fait dans la confiance, avec beaucoup de réactivité et de bon goût. Je recommande les yeux fermés !

Maxime est quelqu'un de très sérieux et très pro. Il a su s'adapter à former des apprenants en formation pro, aussi bien en présentiel et distanciel, en faisant preuve d'une grande pédagogie et d'une belle expertise. Un vrai plaisir de travailler avec lui.

J'ai pu travailler avec Maxime sur mon site internet et sur mon Logo ! Très professionnel et prend bien en compte les demandes du client !! Je recommande, merci à lui !!

Mirax allie une vraie expertise IA à une forte sensibilité business. Ils ont rapidement compris notre activité et nos enjeux. Restitution claire, structurée et accessible aux non-spécialistes. Sérieux, pédagogues, orientés résultats : collaboration que nous recommandons.

Maxime a su répondre parfaitement à nos attentes dans le cadre de notre projet de site internet ! Vous pouvez le solliciter les yeux fermés

Nos réalisations

Solucar

Étude, sélection et intégration d'un modèle d'intelligence artificielle dans les processus d'une entreprise de gestion de parc automobile française.

E********

Conception d’un middleware local intégrant un LLM pour automatiser la génération de devis, en centralisant et structurant les données métiers.

H********

Mise en place d'un moteur IA pour la recherche produit multi-langue dans plus de 20 000 produits e-commerce.

C'est quoi exactement le RAG et comment ça fonctionne ?

Le RAG fonctionne en trois étapes principales :

- Étape 1 — Indexation : vos documents sont découpés en chunks, transformés en vecteurs sémantiques et stockés dans une base vectorielle

- Étape 2 — Retrieval : quand un utilisateur pose une question, le système recherche les passages les plus pertinents dans la base vectorielle

- Étape 3 — Génération : les passages récupérés sont injectés dans le contexte du LLM, qui rédige une réponse ancrée dans ces informations

Concrètement : un employé pose une question sur une procédure RH → le RAG retrouve les paragraphes concernés dans votre manuel → le LLM rédige une réponse claire en citant la source. Tout ça en quelques secondes.

Quels types de documents peut-on intégrer dans un système RAG ?

La richesse d'un système RAG tient à la diversité des sources qu'il peut intégrer. Voici les formats les plus courants :

- Documents office : PDF, Word (.docx), PowerPoint (.pptx), Excel (pour les données tabulaires)

- Wikis et bases de connaissance : Notion, Confluence, SharePoint, sites internes

- Outils de ticketing : Zendesk, Intercom, Jira (historiques de tickets et solutions)

- Emails et communications : archives email, transcriptions de réunions, comptes rendus

- Bases de données : données structurées via des connecteurs SQL ou API

- Contenus audio/vidéo : transcriptions de formations, démonstrations produit

Nous mettons en place les pipelines d'ingestion adaptés à chaque type de source, y compris pour les mises à jour automatiques.

Comment éviter les hallucinations avec un système RAG ?

Les hallucinations sont la première crainte des entreprises vis-à-vis des LLM. Le RAG les attaque à la racine.

Les mécanismes anti-hallucination que nous intégrons :

- Prompt système restrictif : le LLM est explicitement instruit de ne répondre qu'à partir des passages fournis, jamais de son savoir général

- Citation obligatoire des sources : chaque affirmation est liée à un document source vérifiable

- Gestion de l'absence de réponse : si la base ne contient pas l'information, le système répond « je ne trouve pas cette information dans la documentation disponible » plutôt que d'inventer

- Score de confiance : affichage du niveau de pertinence des sources utilisées pour chaque réponse

Avec ces garde-fous, le taux d'hallucination est réduit à une fraction infime des réponses, contrôlable et améliorable en continu.

Quelle différence entre le RAG et le fine-tuning d'un LLM ?

C'est une question fondamentale pour choisir la bonne approche :

- Fine-tuning : on modifie les poids du modèle avec vos données. Coûteux, long, et les connaissances inculquées deviennent rapidement obsolètes. Pertinent pour adapter le style ou le comportement du modèle, pas pour lui injecter des faits métiers changeants.

- RAG : on enrichit le contexte du modèle à chaque requête avec des documents récents. Flexible, mise à jour instantanée, traçable et moins coûteux. Idéal pour des bases de connaissance évolutives.

Dans la plupart des cas métiers, le RAG est la bonne réponse. Le fine-tuning peut compléter le RAG pour adapter le ton ou le format des réponses, mais il ne le remplace pas.

Comment contrôler qui a accès à quels documents dans le système RAG ?

La gestion des droits d'accès est un enjeu critique en entreprise, surtout quand la base RAG contient des documents de confidentialités différentes.

Notre implémentation garantit que chaque utilisateur ne voit que ce qu'il est autorisé à voir :

- Métadonnées de contrôle d'accès : chaque chunk est taggé lors de l'indexation (niveau de confidentialité, département, liste d'utilisateurs autorisés)

- Filtrage dynamique au retrieval : la recherche est automatiquement restreinte aux chunks accessibles par l'utilisateur connecté

- Intégration SSO : les droits sont synchronisés avec votre annuaire d'entreprise (Active Directory, Okta, Google Workspace)

- Audit des accès : journalisation de chaque requête et des sources utilisées, pour un contrôle complet de qui a accédé à quelle information

.avif)

.avif)