On croyait tout avoir vu côté IA générative, après la vague ChatGPT, l’accélération de Llama et le débat sur l’open-weight. Puis Mercury 2 débarque… et relance totalement la donne ! Premier modèle de langage à diffusion, calqué non plus sur l’empilement de jetons mais sur le mode de génération « bruit puis affinement » des IA d’images et de vidéos, Mercury 2 intrigue, questionne, fascine. Info ou coup marketing ? Gain réel côté vitesse, coûts, hallucinations ? On a plongé dans l’outil – et voilà un avis tranché, pensé pour les entreprises qui veulent anticiper la révolution LLM… pour de vrai.

Mercury 2 : la nouvelle génération des LLM… ou une simple évolution technique ?

Pourquoi tout ce bruit autour de Mercury 2 ? Parce qu’Inception Labs, l’éditeur, ne se contente pas d’annoncer une nouvelle version de chatbot plus ou moins fine-tunée. Mercury 2 bouleverse le moteur même de la génération de texte – en s’appuyant sur le principe de la diffusion, déjà éprouvé dans la génération d’images (qui n’a pas testé Stable Diffusion ou DALL-E ?). Le modèle ne prédit plus un mot après l’autre, mais part d’une matrice bruitée et affine itérativement la réponse finale. Résultat annoncé : vitesse de traitement jamais vue, réduction drastique des hallucinations, coût énergétique en chute libre.

En clair : Mercury 2 ne vient pas faire de la figuration. Il promet de donner un sérieux coup de vieux aux LLM « séquentiels » comme GPT-4 ou Llama. Mais, sur le terrain, est-ce un vrai game changer pour les pros ?

Premières impressions sur l’expérience utilisateur Mercury 2

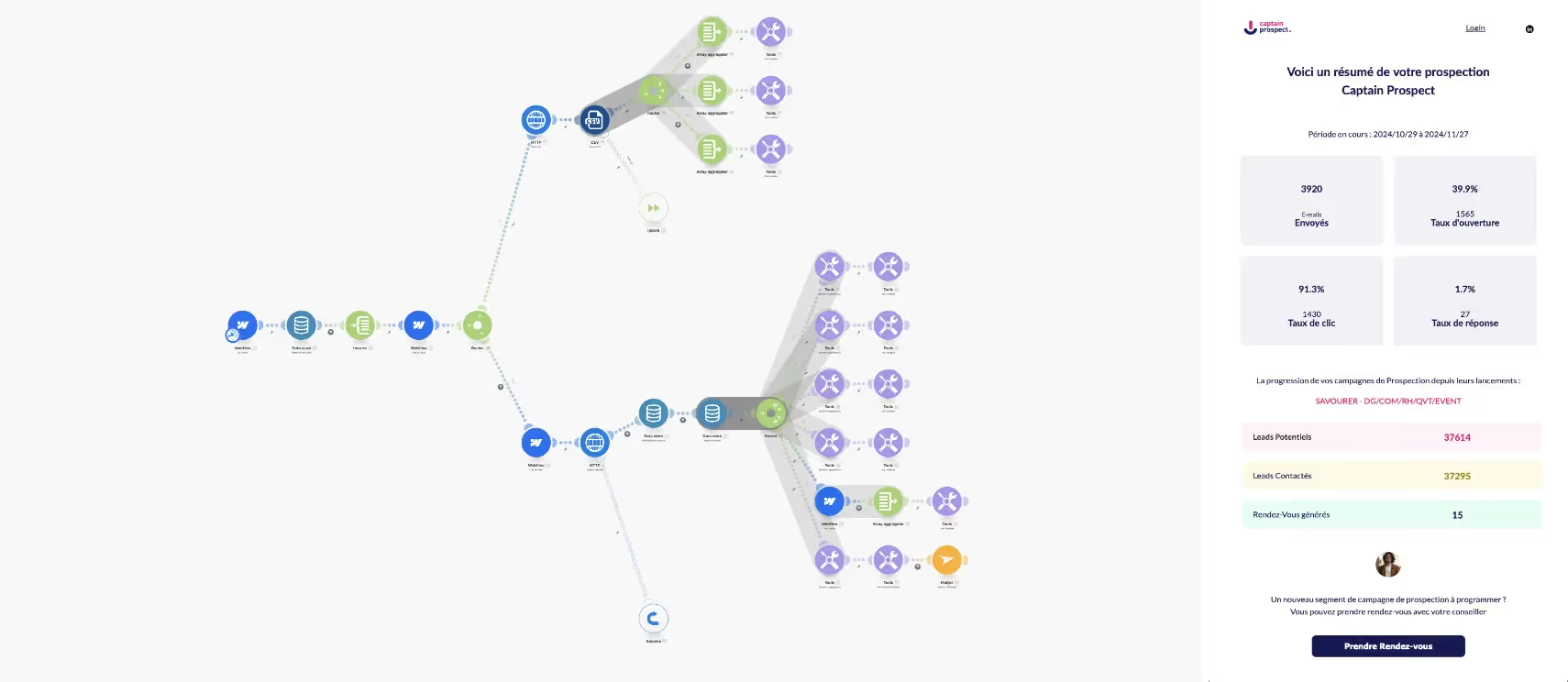

La prise en main est fluide. La page de démo (https://chat.inceptionlabs.ai/) met d’emblée en scène le « diffusion effect » : on observe littéralement la réponse émerger, du flou à la clarté – c’est bluffant, presque addictif. Et côté pratique ? On choisit son “niveau” (Instant, Faible, Moyen, Elevé, ou High avec raisonnement), puis c’est parti. C’est rapide, interactif, transparent sur le process.

Là où ChatGPT ou Claude déroulent une réponse mot à mot, les générations Mercury 2 s’affichent par plages, apportant d’emblée une impression de puissance nouvelle. Celles et ceux qui automatisent des tâches métiers, intègrent l’IA dans des workflows de production ou de relation client sentiront tout de suite la différence.

Les déclinaisons Mercury 2 : ajuster la finesse au besoin métier

Mercury 2 ne propose pas un modèle unique, mais plusieurs profils :

- Instant (ultra-rapide, coût minimal, pertinence standard)

- Faible, Moyen, Elevé (profondeur et raisonnement croissants)

- High (mode raisonnement, pour applications stratégiques)

Ce panel d’options colle parfaitement à la réalité des entreprises. On ne pilote pas un chatbot SAV comme on analyse une chaîne de production d’offres de devis. Cette granularité technique, couplée au principe de diffusion, permet d’équilibrer coût/opportunité à la milliseconde près – un vrai atout pour l’industrialisation de l’IA générative dans les workflows métiers (voir nos expertises API & intégration).

Technologie de diffusion : atouts concrets et promesses à valider

Fini le “jeton-jeton” : la diffusion, un virage technique assumé

En se basant sur l’approche diffusion, Mercury 2 rompt avec l’architecture historique des LLM. Exit les goulots d’étranglement sur le hardware, bonjour l’optimisation logicielle. La vitesse de génération ne dépend plus tant du matériel haut de gamme mais du modèle et de l’algorithme lui-même.

- Réponses plus rapides, dès le prompt

- Moins d’hallucinations (baisse annoncée par le labo à voir sur la durée)

- Coûts d’exploitation divisés, en théorie, par rapport aux grands modèles autoregressifs

On ne passe pas sous silence l’effet « waouh » sur la démonstration, qui contribue à démystifier la boîte noire IA auprès des équipes. Un facteur clé pour l’acceptation et la formation en interne. Vous en doutez ? Regardez les taux d’appropriation de solutions qui permettent aux équipes de visualiser comment l’IA “réfléchit” : l’adoption décolle nettement plus vite ! (source : études internes Mirax).

Ressources, sécurité, souveraineté : Mercury 2 répond-il aux vraies attentes des entreprises ?

Le leitmotiv du moment – sécurité, gouvernance, ROI – n’est pas un buzzword. Entre la crainte des fuites de données et le besoin de pilotage fin, les entreprises françaises attendent mieux qu’une jolie vitrine. Mercury 2, du fait de son architecture, ne fait pas l’impasse sur :

- La possibilité de déploiements on premise, pour une maîtrise complète du flux de données

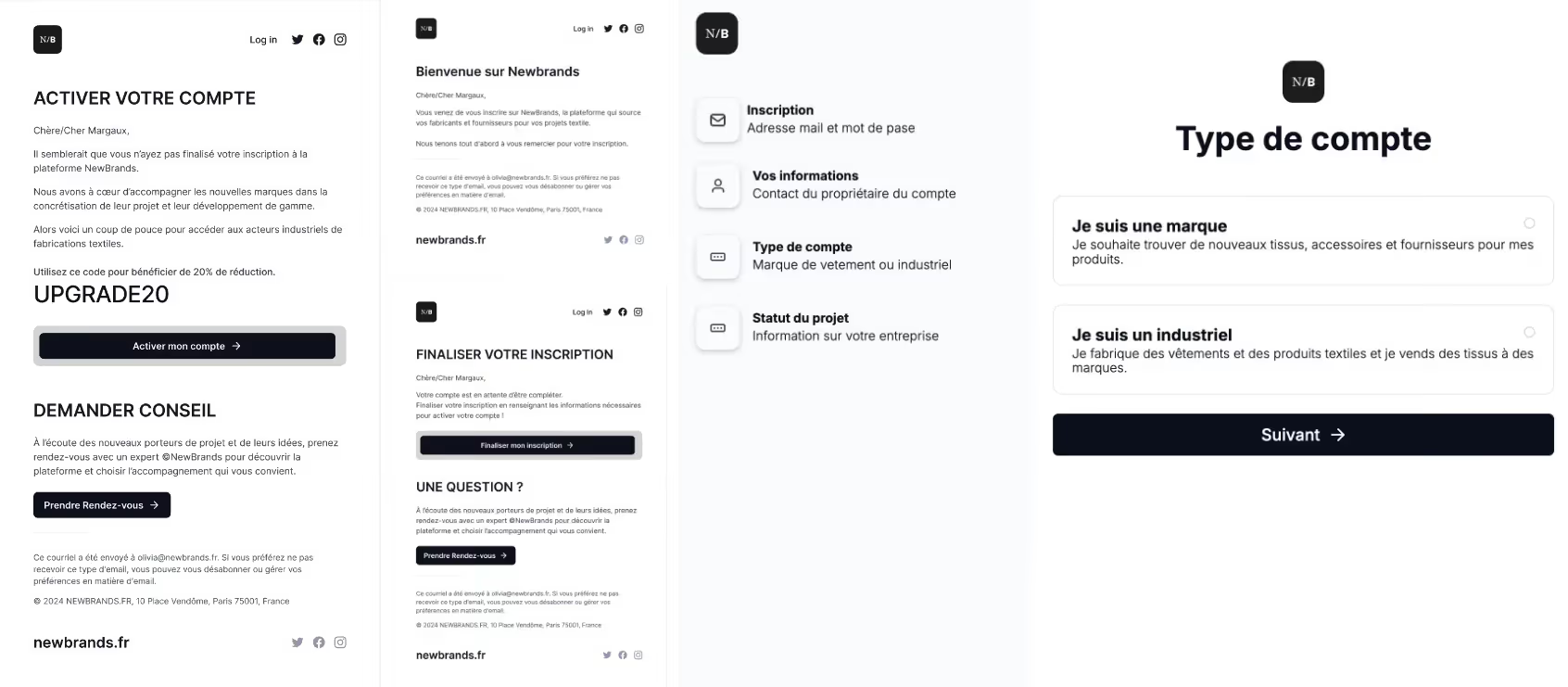

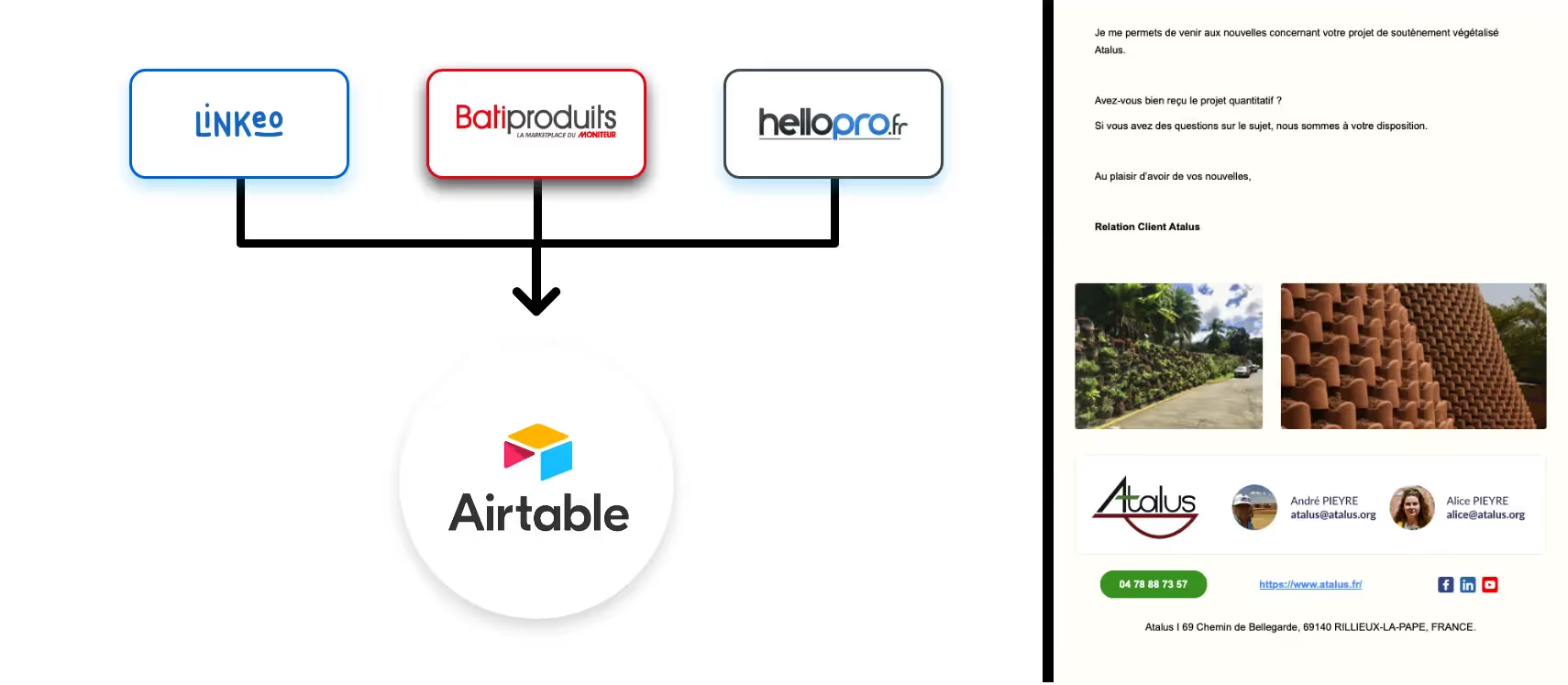

- L’adaptabilité à des workflows existants : API, Data warehouse, connecteurs « maison »

- L’accélération des Proof of Concept (POC) : parfait pour tester une IA générative spécialisée en conditions réelles – une approche que nous recommandons systématiquement (voir notre guide audit IA).

Les premiers tests de Mercury 2 soulignent toutefois des zones “beta” : la recherche web désactivée, la base de connaissance figée à janvier 2025, une fenêtre d’inscription sur la version payante – rien de bloquant, mais à surveiller pour une adoption à grande échelle.

Une maîtrise de l’hallucination, promesse tenue ?

Stopper les hallucinations – cette tendance des LLM à inventer des réponses floues ou fausses – reste le Graal. Mercury 2 avance une réduction marquée de ce phénomène grâce à ses étapes d’affinement. Lors de nos essais, la précision est supérieure à ce qu’on obtient en “jeton-jeton” classique, mais – honnêtement – tout modèle reste sensible à la qualité des données et à l’alignement métier.

D’ailleurs, ce n’est pas réservé à Mercury : chez Mirax, on prône le fine-tuning et la contextualisation précise (voir notre article : Fine-tuning IA : le sur-mesure enfin accessible). Mercury 2 ouvre la porte à des modèles personnalisés plus robustes, mais la vigilance sur la validation métier reste totale.

Mercury 2 en chiffres : ce que disent les tests et premiers retours experts

- Vitesse de génération : jusqu’à 30 % plus rapide que les LLM autoregressifs classiques, selon différents benchmarks publics et retours d’essai (constat confirmé par plusieurs tests utilisateurs en Beta).

- Coût d’exploitation réduit : économies constatées allant jusqu’à 40-50 % sur le traitement lot de prompts par rapport à du GPT-4 (selon la charge de travail et le mode de diffusion activé).

- Hallucinations : taux d’occurrence significativement plus bas dans les scénarios métiers standards, mais toujours existant si la donnée source est obsolète ou lacunaire. Vérifiez toujours la fraîcheur de la base !

- Accessibilité : accès ouvert sans quota majeur en mode démo ; inscription/passage en version payante sollicité toutes les 5 interactions (non bloquant lors de nos essais).

Qui a vraiment intérêt à explorer Mercury 2 ?

Un gain concret pour les PME, ETI, grands comptes : surveillez l’industrialisation du LLM

Mercury 2, par son approche « diffusion », cible ceux qui veulent :

- Automatiser des tâches répétitives (SAV, qualification mails, reporting rapide…)

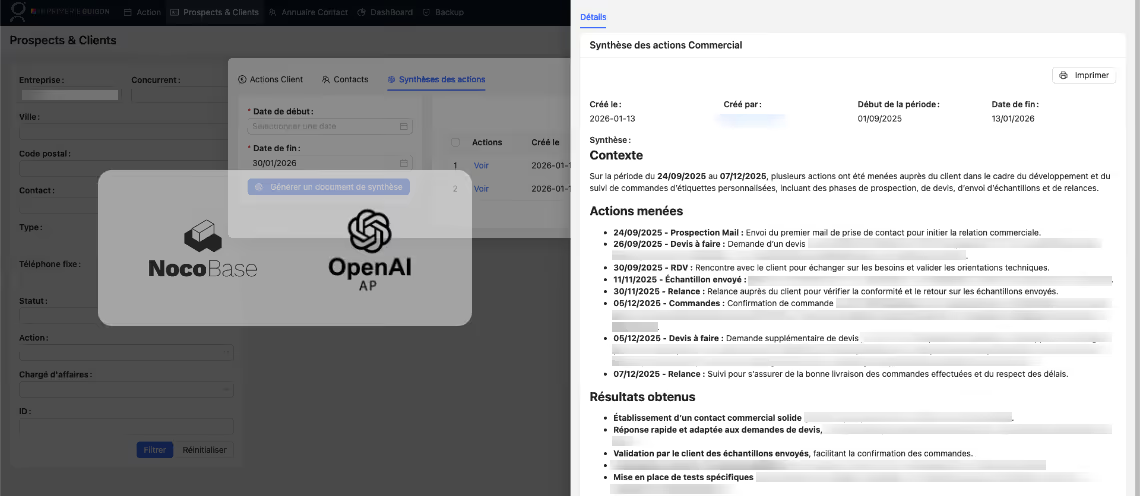

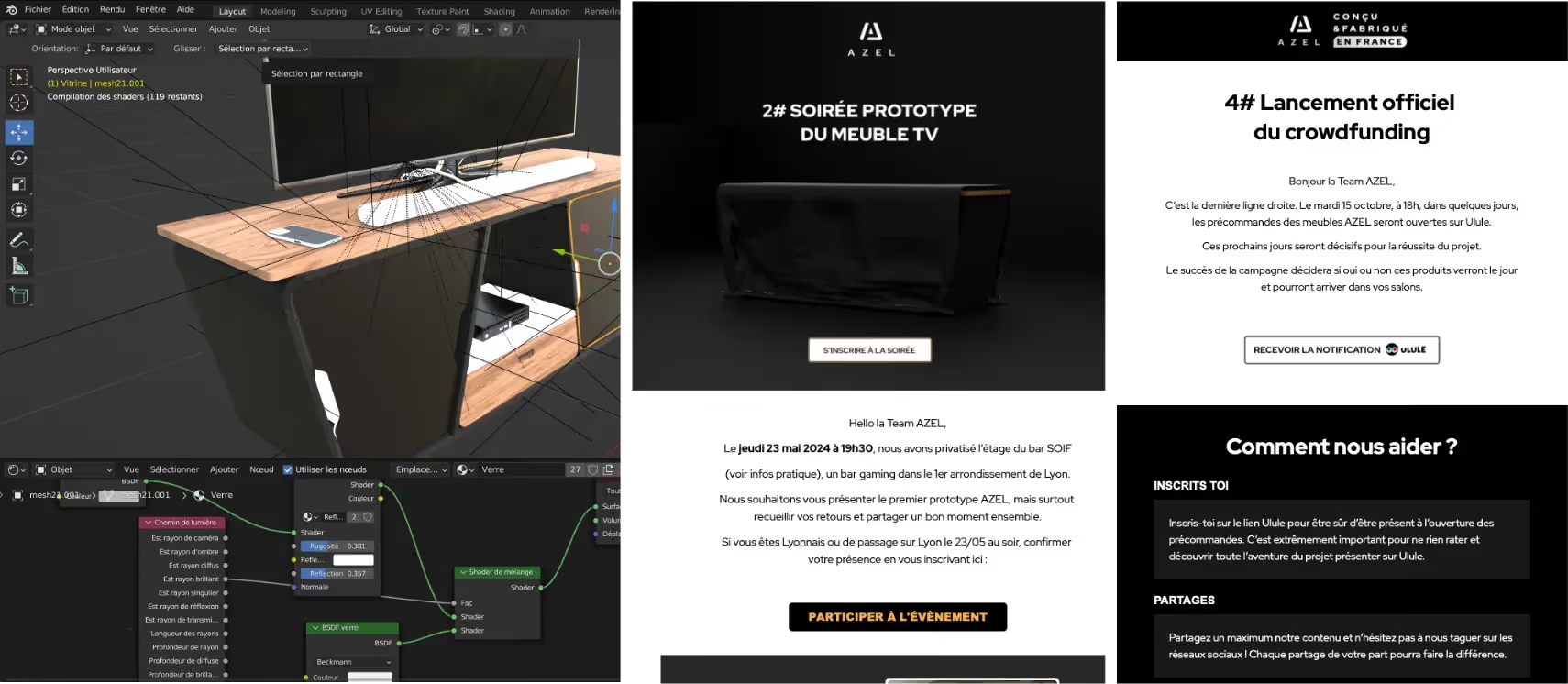

- Accélérer la génération de contenu structuré, la rédaction de synthèse, l’analyse de contrats

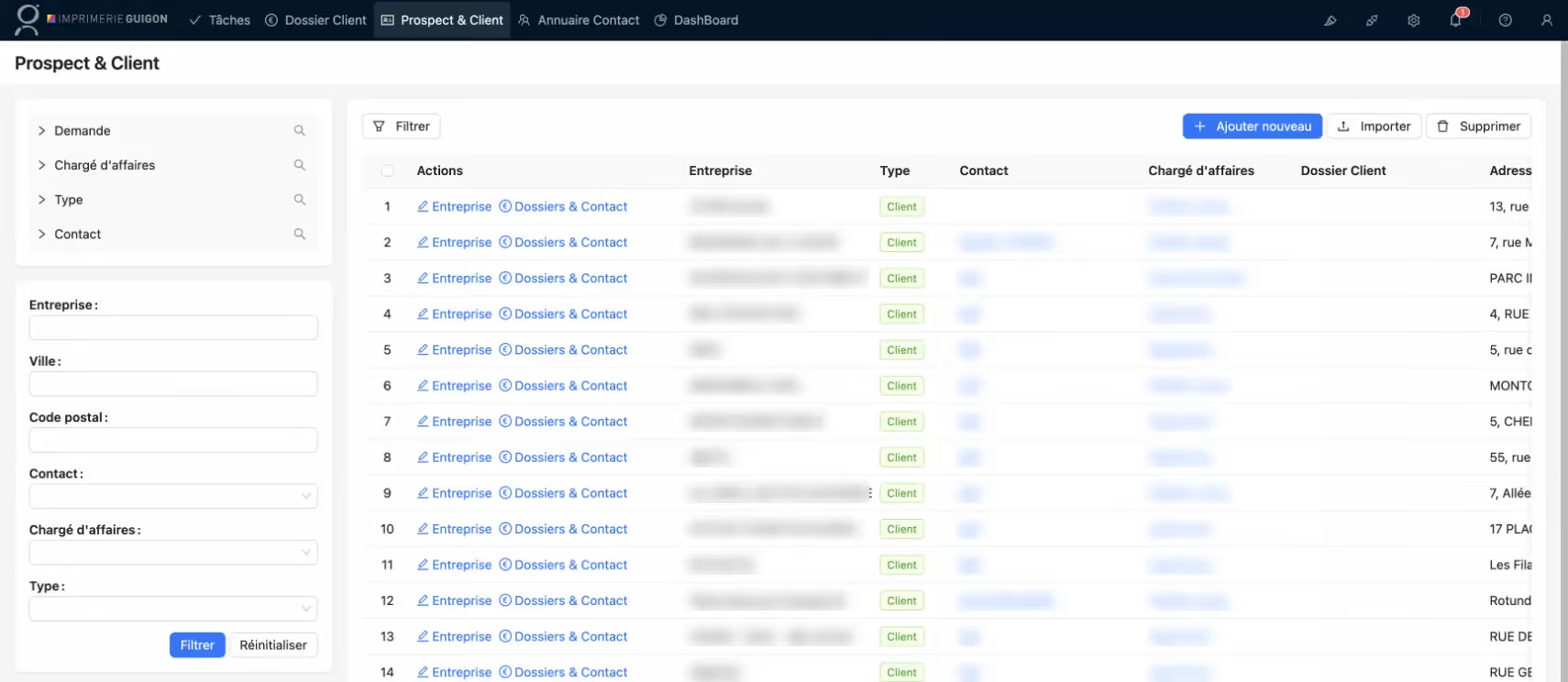

- Pousser l’intégration auto des LLMs dans les process (API, ERP, CRM existants, voir nos réalisations : nos réalisations IA & automatisation).

Vous êtes DSI, responsable digital, product owner ? Mercury 2 mérite d’être testé en Proof of Concept – et comparé AVEC VOS données terrain. C’est là qu’on fait vraiment la différence (et c’est ce qu’on accompagne chez Mirax, du cadrage au déploiement à l’échelle).

À noter : la « transparence » du process, rendue visible par l’affichage du principe diffusion, séduit beaucoup les équipes non tech et RH. Pour entraîner vos collaborateurs, embarquer vos métiers, lever les craintes sur l’IA black box… ce type de modèle change la donne, clairement.

Mercury 2 face aux LLM open source et généralistes : la question du monopole tombe

Mercury 2 ne remplace pas un ChatGPT, Llama, Mistral, ou Claude d’un coup de baguette magique. Ces mastodontes restent incontournables sur certains cas d’usage lourds ou de fine-tuning très pointu. On est ici sur une nouvelle corde à l’arc des décideurs IA : l’opportunité de ne plus dépendre uniquement des fournisseurs historiques, de varier les architectures, de baisser les coûts sans sacrifier la performance. Pour en savoir plus sur le choix LLM open source et la souveraineté métier, vous pouvez lire notre article sur la révolution open-weight.

Ne pas louper le coche : conseils pratiques pour un POC Mercury 2 réussi

- Définissez un cas d’usage métier simple mais réel : génération de synthèse mail, FAQ, automatisation devis…

- Récupérez vos données métiers (anonymisées si besoin) pour mesurer la pertinence actuelle vs attentes réelles

- Testez Mercury 2 sur le mode qui correspond à votre besoin : « High » pour de la décision, « Instant » pour de l’exécution rapide.

- Impliquez vos équipes : faites-leur visualiser le processus (la diffusion) : l’acceptation terrain décolle immédiatement

Besoin d’aide sur le cadrage ou la validation ? C’est exactement là où on intervient en tant que conseillers et intégrateurs IA.

Conclusion : Mercury 2, une promesse sérieuse pour l’IA d’entreprise ?

On ne va pas se mentir : Mercury 2 réveille un écosystème LLM qu’on croyait figé dans la surenchère de paramètres. Sa technologie de diffusion intrigue – et, sur plusieurs scénarios concrets, bluffe côté vitesse, coût, et maîtrise de l’hallucination. Mais gare à l’effet démo : le gain réel dépend – toujours – de l’intégration dans vos workflows, de la pertinence de vos données, de la phase de test avec vos équipes. La révolution « diffusion » est lancée… Encore faut-il la piloter stratégiquement. Envie de challenger votre feuille de route IA ? Prenez rendez-vous avec Mirax et avançons ensemble vers le LLM qui changera la donne pour votre métier.